主打中文的 AI 模型开源社区魔搭 ModelScope 上线,会成为国内的主流社区吗?

点击上方关注 “终端研发部”设为“星标”,和你一起掌握更多数据库知识很显然,中文的AI模型已经在国内开始蔓延了从去年我就体验过,觉得还是挺有意思的。ModelScope是阿里达摩院于近一年刚上线的一款开源模型平台,里面提供了很多的热门模型供使用体验,而且与阿里云服务进行联动,让开发者免除了额外的部署成本,实现了模型推理与调优的极速体验。ModelScope-Agent 提出了一个通用的、可定制的

点击上方关注 “终端研发部”

设为“星标”,和你一起掌握更多数据库知识很显然,中文的AI模型已经在国内开始蔓延了

从去年我就体验过,觉得还是挺有意思的。ModelScope是阿里达摩院于近一年刚上线的一款开源模型平台,里面提供了很多的热门模型供使用体验,而且与阿里云服务进行联动,让开发者免除了额外的部署成本,实现了模型推理与调优的极速体验。

ModelScope-Agent 提出了一个通用的、可定制的 Agent 框架,方便用户打造属于自己的智能体。它基于开源的大语言模型 (LLMs) 作为核心,提供了一个用户友好的系统库, 具有以下特点:

可定制且功能全面的框架

提供可定制的引擎设计,涵盖了数据收集、工具检索、工具注册、存储管理、定制模型训练和实际应用等功能,可用于快速实现实际场景中的应用。

包括但不限于自然语言处理、计算机视觉、语音识别等。用户可以在平台上发现和探索这些模型,了解其特性和性能。

开源 LLMs 作为核心组件:

支持在 ModelScope 社区的多个开源 LLMs 上进行模型训练,并开源了配套的中英文工具指令数据集 MSAgent-Bench,用于增强开源大模型作为 Agent 中枢的规划调度能力。

按照模态可划分为文本、图像、音频、视频、多模态等。可通过Git方式进行管理,公开的数据集可进行下载使用。

多样化且全面的 API,支持 API 检索:

以统一的方式实现与模型 API 和常见的功能 API 进行无缝集成,默认提供开源 API 检索方案。

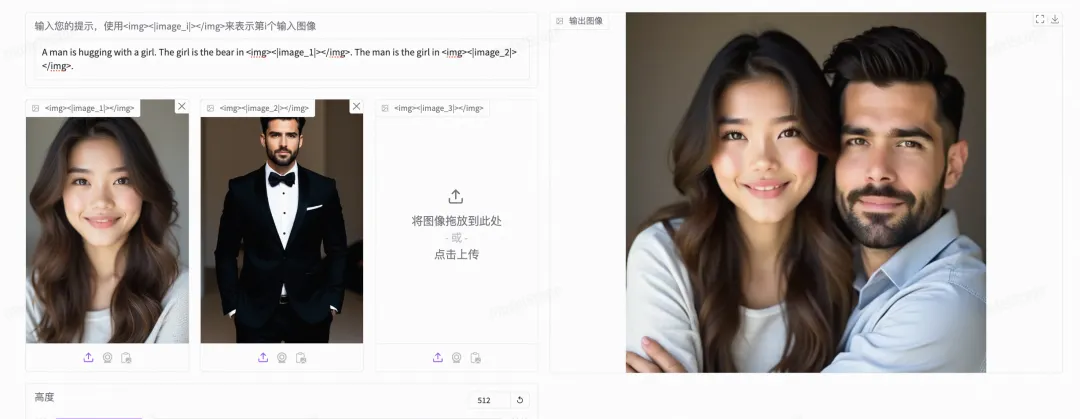

包括自定义的模型输入输出,多模型的组合,以及可视化交互展现形式等等。由创空间为白纸,以模型为颜料,以想象力为画笔,共谱AI应用五彩斑斓的新画卷!

ModelScope-Agent 框架是如何设计的

ModelScope-Agent 是一个通用的、可定制的 Agent 框架,用于实际应用程序开发,其基于开源的大语言模型 (LLMs) 作为核心,包含记忆控制、工具使用等模块。开源 LLM 主要负责任务规划、调度以及回复生成;记忆控制模块,主要包含知识检索以及 prompt (提示词)管理;工具使用模块,包含工具库以及工具检索和工具可定制化。ModelScope-Agent 系统架构如下:

基于检索工具的社区知识问答。

它和Colab定位不同,ModelScode可以创建自己的空间,模板比较多,Gradio、Streamlit、Static都可以,和Huggingface功能有点类似,Huggingface多了一个Docker的SDK类型,都是开源的模型即服务共享平台,汇聚了各领域的先进机器学习模型,提供模型探索、推理、训练、部署和应用的一站式服务。

基于ModelScope-Agent,为ModelScope社区开发了智能助手ModelScopeGPT。它使用LLM作为控制器,连接ModelScope开源社区中的数十个特定领域的AI模型,覆盖NLP、CV、Audio和Multi-Modal领域。

为了使流程更实用,ModelScopeGPT还包括API检索和知识检索工具,以自动选择合适的API并获取本地ModelScope知识。

ModelScopeGPT可以支持多轮对话中的API调用,并利用之前对话中的信息生成正确的API调用参数。发布后一个月内,ModelScopeGPT从4万用户访问中实现了超过17万次的请求。

目前在 AI 开发者圈,魔搭社区已成中国大模型第一门户。所有模型生产者都可以上传自己的模型,验证模型的技术能力和商业化模式,并与其他社区模型进行协作,共同探索模型应用场景。ModelScopeGPT 则实现了将模型生产力进行自由组合,继续强化阿里云在大模型生态建设中的领先地位。

该工具拥有包括创作诗歌、进行绘画、生成视频以及播放语音等多种模态的能力。

如何去玩呢?

入口:https://www.modelscope.cn/studios/damo/ModelScopeGPT/summary

GitHub:

github.com/tyxsspa/AnyText

魔搭社区:

modelscope.cn/models/damo/cv_anytext_text_generation_editing/summary

笔记:

colab.research.google.com/github/camenduru/AnyText-colab/blob/main/AnyText_colab.ipynb

举个例子:

使用图片作为数据集进行GPT4V的在线微调

步骤一:准备数据集——>收集图片——>标注数据

步骤二:创建ModelScope项目,在项目中设置所需的参数,如训练迭代次数、批次大小等。

步骤三:将准备好的图片数据集上传到ModelScope平台,可以使用平台提供的API或图形界面来完成此操作。

步骤四:配置训练任务,可以指定要使用的预训练模型为GPT4V,并设置微调的参数,如微调层数、学习率等。

步骤五:开始训练。启动训练任务,并等待训练完成。

步骤六:评估模型性能

步骤7:模型部署

导航至模型卡片:请在魔搭 ModelScope 社区的模型库页面进行搜索,定位到"baichuan2-7b-chat-4bits",并点击进入该模型的详细页面。为了便捷,您还可以通过提供的URL直接访问该模型卡片。

执行快速部署操作:请在模型卡片的右上角找到并点击“部署”按钮,并从下拉菜单中选择“快速部署(SwingDeploy)”,随后选择“函数计算(FC)”作为目标部署平台。

测试

这顿饭缺少什么营养,吃什么来补充呢?

比如,我们输入一张图片,进行测试

提示词:这是一顿中午饭,缺少什么营养,吃什么来补充呢?

输出:

根据您提供的图片,这顿饭主要由米饭和鸡肉组成,可能缺乏充足的维生素、矿物质和膳食纤维。为了补充营养,可以添加一些蔬菜,比如绿叶蔬菜、胡萝卜或豌豆,以增加维生素和矿物质的摄入量。此外,加入一些豆类或坚果可以提供额外的蛋白质和纤维,有益于保持饱腹感并促进消化健康。如果饮食中限制了肉类,可以考虑用豆类或豆腐替代鸡肉,以获得植物性蛋白质来源。最后,不要忘记用水果作为甜点来获取天然糖分和更多的维生素。

食物分量估计

下图展示了三种方法包括GPT-4V、人眼估计和基准真值对食物分量的估计,图中观察到的趋势表明,GPT-4V的预测通常与基准真值非常接近。

看着还挺像那么回事,有了GPT-4V督促,就不用担心一不小心吃多啦!

相对于其他的大模型,更喜欢这种可以支持本地部署的量级模型。针对模型推理、训练流程,进行了模块化的设计,ModelScope提供了丰富的功能模块实现,方便用户定制化开发来自定义自己的推理、训练等过程。

这种轻量级的应用,可以用普通8g显存的家用电脑来运行,对于机器学习有很大的帮助,我也创建了好几个实例

在线抠图

用了不同环境,修改方法才慢慢摸索出来,而且试多了也大概知道一些错误怎么修改还有修改原因之类的,所以越到后面越熟练了

当然你可以在上面找一些项目自己动手做做,很轻松就能实现一个项目。由于我比较喜欢计算机视觉方面,所以我介绍几个计算机视觉方面的,这里还有很多模型如果有你喜欢的大家可以去尝试尝试~

写在最后的话

大家看完有什么不懂的可以在下方留言讨论,也可以私信问我一般看到后我都会回复的。最后觉得文章对你有帮助的话记得点个赞哦,点点关注不迷路

@终端研发部

每天都有新鲜的干货分享!

回复 【idea激活】即可获得idea的激活方式

回复 【Java】获取java相关的视频教程和资料

回复 【SpringCloud】获取SpringCloud相关多的学习资料

回复 【python】获取全套0基础Python知识手册

回复 【2020】获取2020java相关面试题教程

回复 【加群】即可加入终端研发部相关的技术交流群

阅读更多

AI赛道OpenAI推出新模型 CriticGPT,让AI更加智能!

我觉得AI的方向搞错了

现在的GPT4或者sora明明一点工业都不沾,怎么大家都高潮了?

太扎心!排查阿里云 ECS 的 CPU 居然达100%

一款vue编写的功能强大的swagger-ui,有点秀(附开源地址)

相信自己,没有做不到的,只有想不到的在这里获得的不仅仅是技术!

点“在看”支持小于哥呀,谢谢啦更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)