社区供稿 | 更长、更强、更开放,零一万物 Yi-1.5 系列开源模型发布一周广受好评

5 月 13 日,零一万物 Yi 系列开源模型全新升级为 Yi-1.5。相较于去年 11 月的开源版本,这次的 Yi-1.5 在保持原 Yi 系列模型优秀的通用语言能力的前提下,通过增量训练 500B

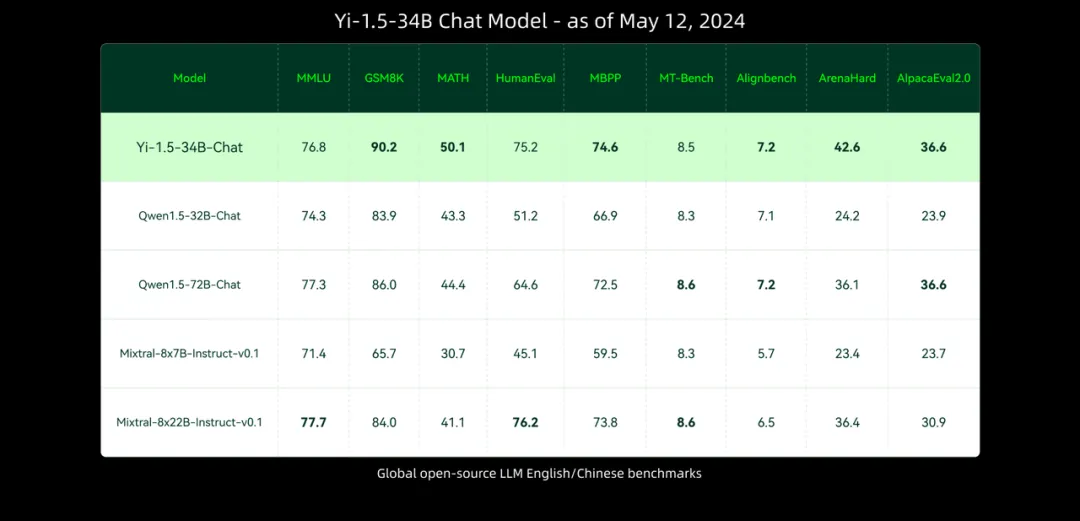

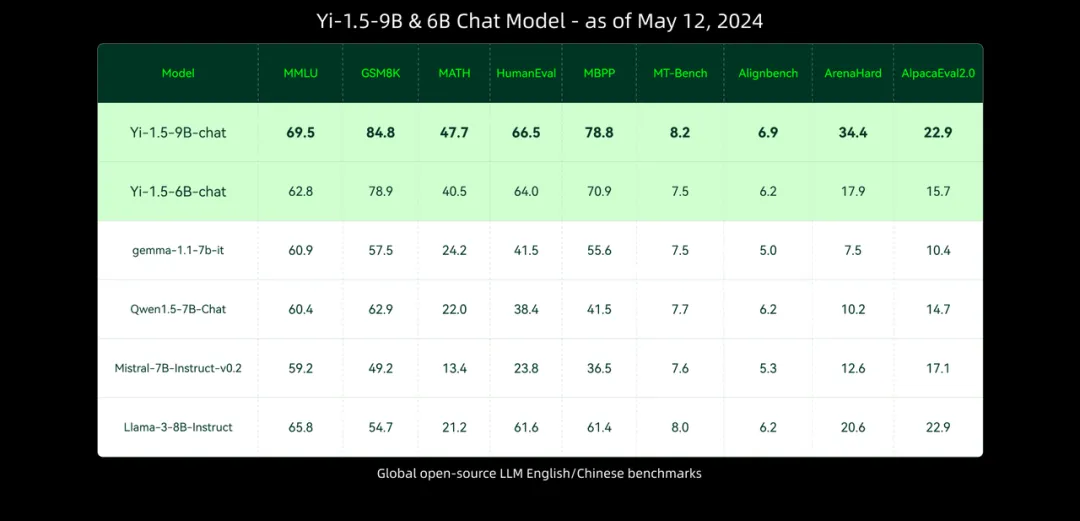

5 月 13 日,零一万物 Yi 系列开源模型全新升级为 Yi-1.5。相较于去年 11 月的开源版本,这次的 Yi-1.5 在保持原 Yi 系列模型优秀的通用语言能力的前提下,通过增量训练 500B 高质量 token,大幅提高了数学逻辑、代码能力。

同时,我们也听到了来自行业、学界和社区的反馈,在肯定 Yi 的能力的同时,也点出原开源版本的 4K 上下文长度不太够用的问题。因此,我们在 Yi-1.5 系列模型中开源了更长上下文的 16K Chat 模型和 32K 的基座模型,列表如下[1](请点击“阅读原文”前往魔搭社区下载)。至此,本次 Yi-1.5 系列一共更新了 10 个模型。

|

对话模型 |

基座模型 |

|

Yi-1.5-34B-Chat |

Yi-1.5-34B |

|

Yi-1.5-34B-Chat-16K |

Yi-1.5-34B-32K |

|

Yi-1.5-9B-Chat |

Yi-1.5-9B |

|

Yi-1.5-9B-Chat-16K |

Yi-1.5-9B-32K |

|

Yi-1.5-6B-Chat |

Yi-1.5-6B |

16K 的对话模型具有更长的上下文,开箱即用,可以解决更多需要长上下文的任务。同时保持着低资源友好的特性,能够在单张 4090 或者 M 芯片 MacBook Pro 上通过 ollama 跑起来。

32K 的基座模型为社区后续的微调工作提供了坚实的基础。这也是在 2023 年 11 月发布的 Yi 系列模型时,我们看到了包含 Nous-Capybara-34B、Faro-Yi-9B、blossom-v5-32b 等都是基于 Yi 模型做出更多优秀的衍生模型。

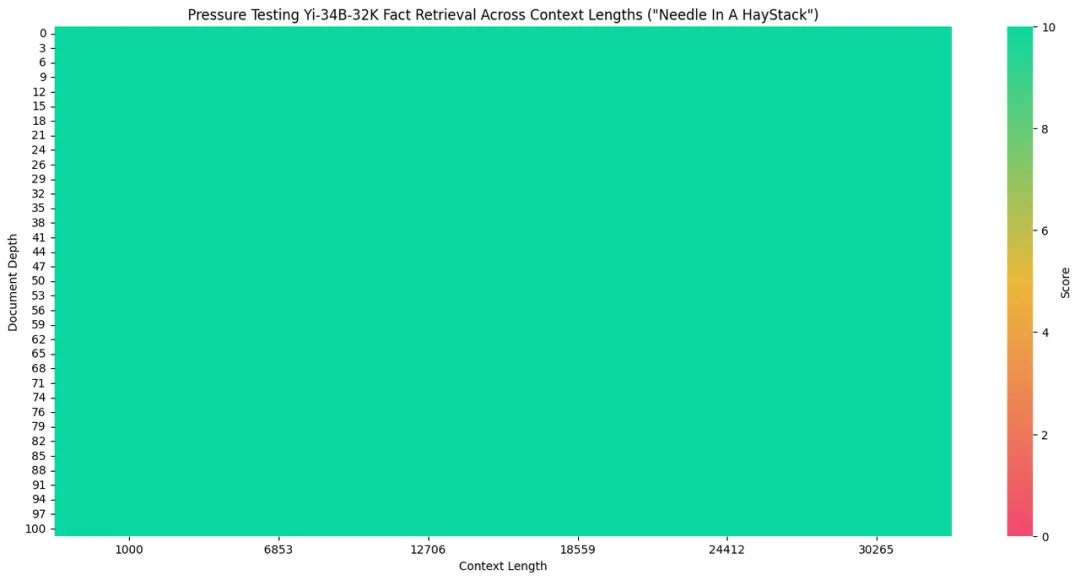

我们在 Yi-1.5-34B 和 9B 模型(4K 上下文)的基础上,继续增量训练了 10B 的 token,其中包括了高质量的原生长文本数据, 将基座模型的上下文长度扩展到了 32K。同时,增加上下文的模型在大海捞针测试中也能取得全绿的成绩。

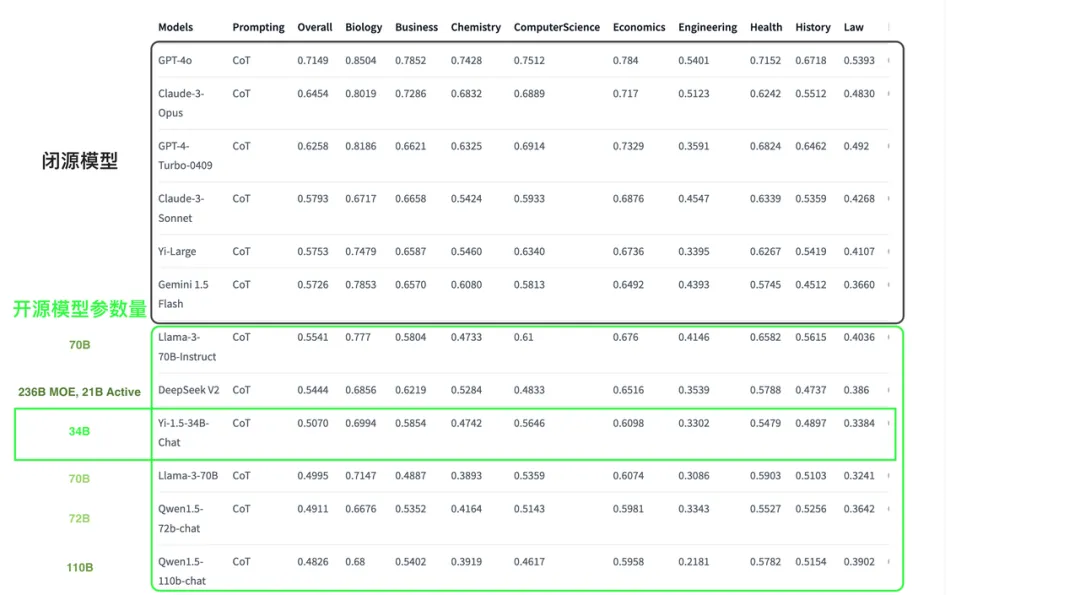

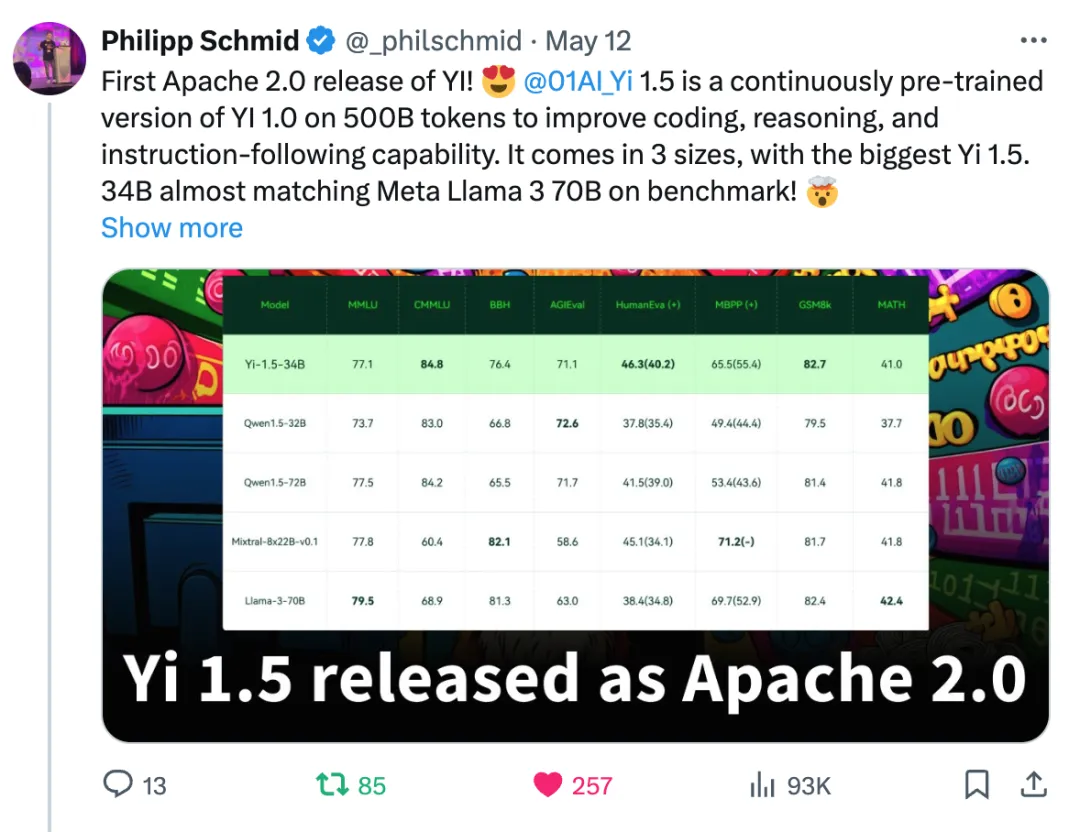

在 5 月 15 日,加拿大滑铁卢大学推出了 MMLU-Pro 榜单 [2]。这是一个 MMLU 榜单的升级版,难度更高,偏向于 STEM 学科,并且经过人工核查。Yi-1.5-34B-Chat 在 MMLU-Pro 中取得了平均分 0.5070 的好成绩。仅用了 34B 的参数量,和 DeepSeek V2、Meta-Llama-3-70B-Instruct 位列开源模型前三名。

Yi-1.5 系列模型发布仅一周,我们已经看到了国内外开源社区的积极响应和广泛讨论,我们列举一些案例(排名不分先后):

-

HuggingFace 社区开发者的微调作品:cognitivecomputations/dolphin-2.9.1-yi-1.5-34b,Azure99/blossom-v5.1-34b,qnguyen3/Master-Yi-9B 等等;

-

魔搭社区的 “为AI成魔” 使用 swift 框架提供了 AWQ 和 GPTQ 的量化版 [3];

-

Yi User Group 的成员 TAOZHIYUAI 第一时间提供了 ollama 的量化版 [4];

-

HuggingChat 上架的 9 款模型中,首款中文模型 [5];

-

算力魔方对 Yi-1.5 模型提供了基于 OpenVINO™️ 工具套件的适配 [6];

-

Second State 对 Yi-1.5 系列模型在 LlamaEdge(Rust + Wasm技术栈)进行了适配 [7];

-

DB-GPT v0.5.6 支持了 Yi-1.5 系列模型 [8];

-

滴普科技进行了 Yi 系列模型在 Fast5000E(华为昇腾一体机)上的适配;

-

等等

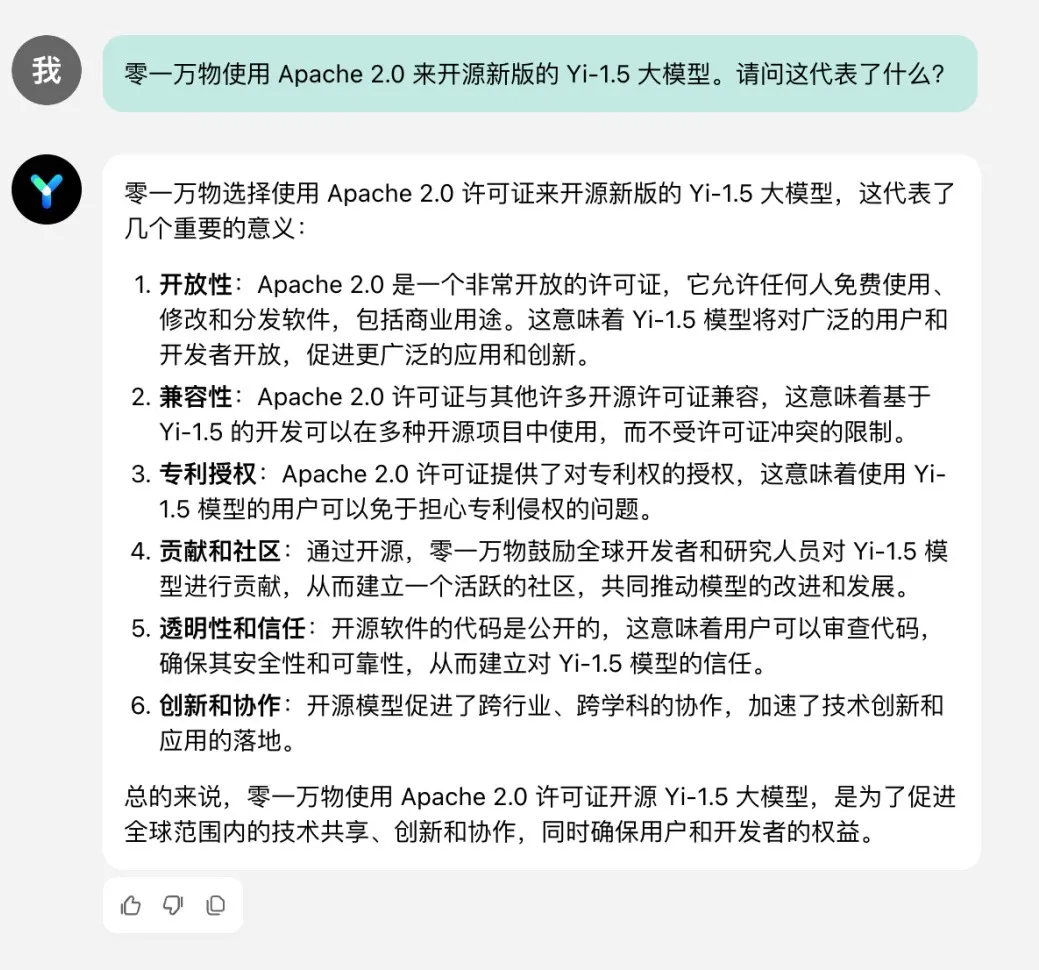

在 Yi-1.5 发布的同时,我们也更新了 Yi 系列模型的开源许可证,从 Yi Series Models Community License Agreement 变更为 Apache 2.0,这获得了广大开发者的关注。各机构在发布开源模型时,基于各种不同考虑,未必会选用 OSI 审核的开源许可证;Yi 在去年 11 月开源时,也自定义了可免费商用的 Yi License。不过,在过去半年,我们得到来自海内外的行业、学界和社区的反馈,认为在大模型开源许可证还没有行业通用标准的阶段,应该先选用开发者最熟悉的宽松许可证—— Apache 2.0,因此我们也选择在 Yi-1.5 发布之际刷新了我们的开源许可证。

上图是 Hugging Face 的 Tech Lead 在 Yi-1.5 使用 Apache 2.0 开源时自制的图,也能看出大家的兴奋感。如果您有这个疑问:为什么开发者那么兴奋于 Apache 2.0?不妨参考 “万知” 的回答:

零一万物的愿景是:让通用人工智能普惠各地,人人受益。我们认为大模型的开发人群主要包括3个大类:社区爱好者,企业开发者和学术研究人员。我们真诚的希望这次的 Yi-1.5 系列开源模型升级,不论是开箱即用、还是进行微调,不论是作为业余时间的个人项目、还是结合自身业务场景提升工作效率,都能够为各种人群带来价值。

哦对了,5月16日,我们零一万物迎来了 1 周年的生日🎉。非常感谢大家的支持,我们会继续努力的!

引用:

[1] https://www.modelscope.cn/brand/view/Yi1_5

[2] https://huggingface.co/datasets/TIGER-Lab/MMLU-Pro

[3] https://www.modelscope.cn/models/AI-ModelScope/Yi-1.5-34B-Chat-AWQ/summary

[4] https://ollama.com/taozhiyuai/yi-v1.5-chat-16k

[5] https://huggingface.co/chat/

[6] https://mp.weixin.qq.com/s/IwuTOLGVvt-eIACyHWcuTQ

[7]https://mp.weixin.qq.com/s/ntMs2G_XdWeM3I6RUOBJrA

[8]https://mp.weixin.qq.com/s/pKU9uEhuZWbVMwRrT4tltw

点击链接👇直达原文

更多推荐

已为社区贡献634条内容

已为社区贡献634条内容

所有评论(0)