RWKV-7革新序列建模,Impossible Videos探索超现实,Creation-MMBench点燃创意火花: 今日论文

由 RWKV 项目(Linux Foundation AI & Data)和 EleutherAI 等机构提出的 RWKV-7 "Goose",是一种全新的序列建模架构。它在30亿参数规模上刷新了多语

作者:InternLM、Qwen 等 LLM每日一览热门论文版,AI 时代不迷惘。快来看看由「机智流」和「ModelScope」社区推荐的今日论文吧。

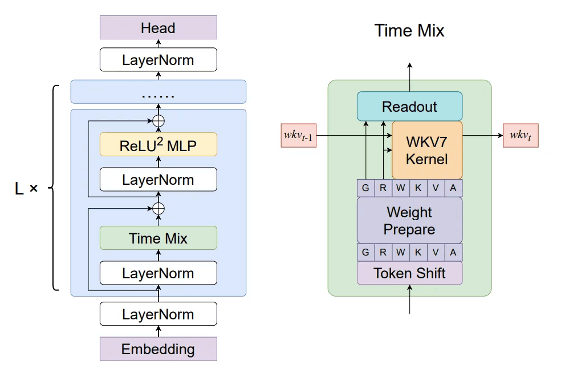

RWKV-7 "Goose" with Expressive Dynamic State Evolution

论文链接:

https://modelscope.cn/papers/128111

简要介绍:

由 RWKV 项目(Linux Foundation AI & Data)和 EleutherAI 等机构提出的 RWKV-7 "Goose",是一种全新的序列建模架构。它在30亿参数规模上刷新了多语言任务的下游性能纪录,媲美顶级英文语言模型,同时仅需恒定内存和推理时间。核心创新包括广义delta规则和上下文学习率优化,超越了传统Transformer的表达能力。作者还开源了3.1万亿token的多语言数据集和代码,助力社区研究。

核心图片:

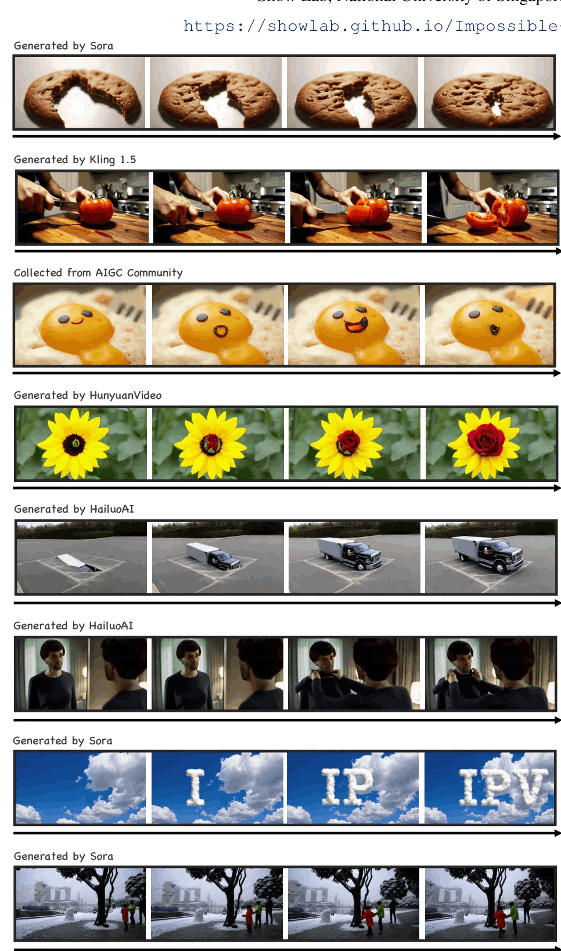

Impossible Videos

论文链接:

https://modelscope.cn/papers/128074

简要介绍:

由新加坡国立大学 Show Lab 提出的 "Impossible Videos" 研究,聚焦于生成和理解“不可能视频”(如违反物理规律的场景)。该工作推出了 IPV-Bench 基准,包含4大领域、14类场景,挑战视频生成与理解模型的极限。实验揭示了现有模型在创意与推理上的不足,为下一代视频模型指明方向。

核心图片:

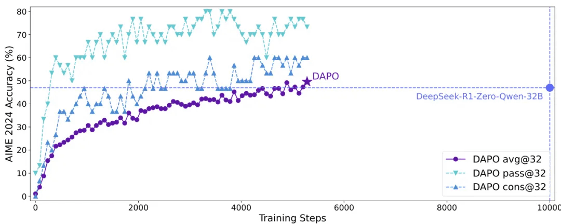

DAPO: An Open-Source LLM Reinforcement Learning System at Scale

论文链接:

https://modelscope.cn/papers/128212

简要介绍:

由 ByteDance Seed 和清华大学 AIR 等机构联合开发的 DAPO,是一种开源的大规模强化学习系统,基于 Qwen2.5-32B 模型在 AIME 2024 上取得50分佳绩。它提出了“解耦剪切与动态采样策略优化”算法,通过四大技术突破提升了长链推理能力,完全开源代码和数据集,推动社区复制工业级RL成果。

核心图片:

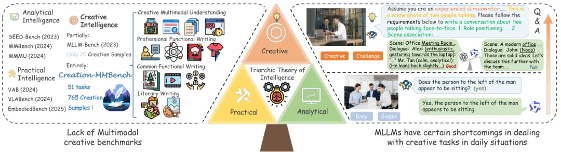

Creation-MMBench: Assessing Context-Aware Creative Intelligence in MLLM

论文链接:

https://modelscope.cn/papers/127996

简要介绍:

由浙江大学、上海人工智能实验室等机构推出的 Creation-MMBench,是首个评估多模态大语言模型(MLLM)创意能力的基准。它包含765个测试用例,覆盖51个细粒度任务,揭示开源MLLM在创意任务中远逊于商业模型,并分析视觉微调对创造力的负面影响,为多模态智能发展提供洞见。

核心图片:

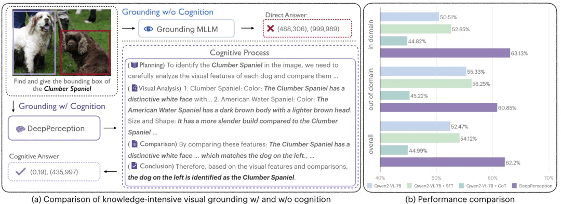

DeepPerception: Advancing R1-like Cognitive Visual Perception in MLLMs for Knowledge-Intensive Visual Grounding

论文链接:

https://modelscope.cn/papers/127746

简要介绍:

由澳门大学、清华大学等机构提出的 DeepPerception,针对知识密集型视觉接地(KVG)任务增强了MLLM的认知视觉感知能力。通过自动数据合成和两阶段训练框架(监督微调+强化学习),它在 KVG-Bench 上提升了8.08%的准确率,展现出卓越的跨领域泛化能力。

核心图片:

Infinite Mobility: Scalable High-Fidelity Synthesis of Articulated Objects via Procedural Generation

论文链接:

https://modelscope.cn/papers/127434

简要介绍:

由上海人工智能实验室、香港大学等机构提出的 Infinite Mobility,通过程序化生成技术合成高保真关节对象。它超越传统数据驱动方法,生成结果媲美人工标注数据集,并可作为生成模型的训练数据,推动具身AI任务的扩展。

核心图片:

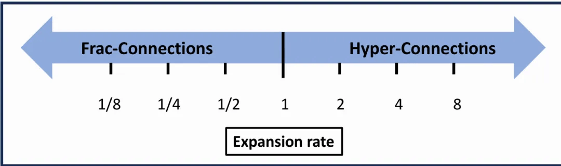

Frac-Connections: Fractional Extension of Hyper-Connections

论文链接:

https://modelscope.cn/papers/128162

简要介绍:

由 ByteDance Seed 团队提出的 Frac-Connections,改进了Hyper-Connections,通过分割隐藏状态而非扩展宽度,降低了内存消耗。它在7B MoE模型上验证了优于残差连接的性能,为深层网络训练提供新思路。

核心图片:

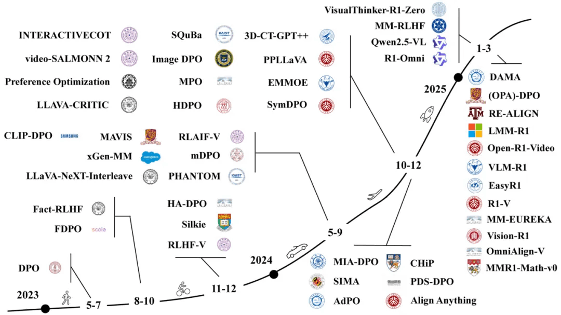

Aligning Multimodal LLM with Human Preference: A Survey

论文链接:

https://modelscope.cn/papers/128033

简要介绍:

由 IEEE Fellow 领衔团队完成的综述,系统回顾了多模态大语言模型(MLLM)与人类偏好对齐的算法。文章探讨了应用场景、数据集构建、评估基准及未来方向,为研究者提供全面指南。

核心图片:

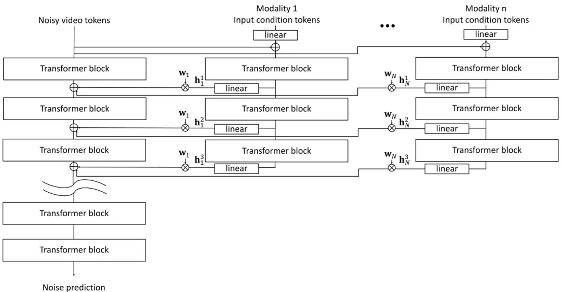

Cosmos-Transfer1: Conditional World Generation with Adaptive Multimodal Control

论文链接:

https://modelscope.cn/papers/128127

简要介绍:

由 NVIDIA 推出的 Cosmos-Transfer1,是一种基于多模态控制(分割、深度、边缘)的条件世界生成模型。它通过自适应时空控制图实现高度可控生成,支持机器人Sim2Real等应用,并在NVIDIA GB200上实现实时推理。

核心图片:

更多推荐

已为社区贡献554条内容

已为社区贡献554条内容

所有评论(0)