langgraph:基于agent和qwen2.5构造一个多功能机器人,私有化部署

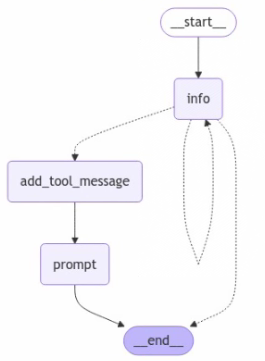

这是聊天机器人所处状态的逻辑。如果最后一条消息是工具调用,那么我们处于“提示创建者”(prompt)应该响应的状态。否则,如果最后一条消息不是HumanMessage,那么我们知道人类应该下一条响应,所以我们处于END状态。如果最后一条消息是HumanMessage,那么如果之前有工具调用,我们处于提示状态。否则,我们处于“信息收集”(info)状态。

最近学习langgraph,试试了官方的项目,基于agent的方式构建一个机器人,挺好玩的,分享给大家。

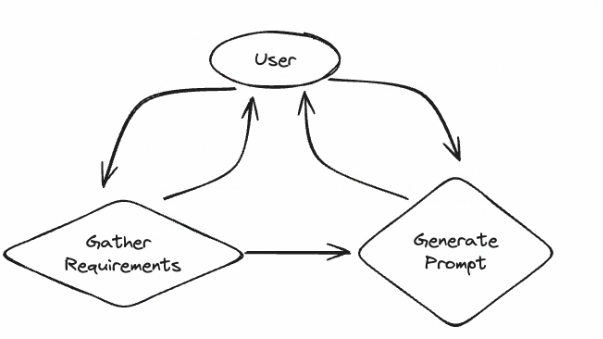

在这个例子中,我们将创建一个聊天机器人,帮助用户生成提示。它将首先从用户那里收集需求,然后生成提示(并根据用户输入对其进行细化)。这些被分为两个独立的状态,LLM决定何时在它们之间转换。系统的图形表示可以在下面找到。

收集信息

首先,让我们定义图中收集用户需求的部分。这将是一个带有特定系统消息的LLM调用。它将可以访问一个工具,当它准备好生成提示时可以调用该工具。

from typing import List

from langchain_core.messages import SystemMessage

from langchain_openai import ChatOpenAI

from pydantic import BaseModel

模型我们使用qwen2.5 目前刚开源,基于ollama调用

template = """你的工作是从用户那里获取他们想要创建哪种类型的提示模板的信息。

您应该从他们那里获得以下信息:

-提示的目的是什么

-将向提示模板传递哪些变量

-输出不应该做什么的任何限制

-输出必须遵守的任何要求

如果你无法辨别这些信息,请他们澄清!不要试图疯狂猜测。

在您能够辨别所有信息后,调用相关工具。

"""

def get_messages_info(messages):

return [SystemMessage(content=template)] + messages

class PromptInstructions(BaseModel):

"""关于如何提示LLM的说明prompt"""

objective: str

variables: List[str]

constrains:List[str]

requirements: List[str]

llm = ChatOpenAI(model="qwen2.5", openai_api_key="ollama", openai_api_base="http://localhost:11434/v1/")

llm_with_tool = llm.bind_tools([PromptInstructions])

# 根据用户的输入 调用 需要的工具

def info_chain(state):

messages = get_messages_info(state['messages'])

response = llm_with_tool.invoke(messages)

return {"messages":[response]}

生成提示

我们现在设置将生成提示的状态。这将需要一个单独的系统消息,以及一个在工具调用之前过滤掉所有消息的函数(因为此时之前的状态决定是时候生成提示了

from langchain_core.messages import AIMessage,HumanMessage, ToolMessage

prompt_system = """根据以下要求,编写一个好的提示模板:

{reqs}

"""

def get_prompt_messages(messages:list):

tool_call = None

other_msgs = []

for m in messages:

if isinstance(m, AIMessage) and m.tool_calls:

tool_call = m.tool_calls[0]['args']

elif isinstance(m, ToolMessage):

continue

elif tool_call is not None:

other_msgs.append(m)

return [SystemMessage(content=prompt_system.format(reqs=tool_call))] + other_msgs

def prompt_gen_chain(state):

messages = get_prompt_messages(state["messages"])

response = llm.invoke(messages)

return {"messages":[response]}

定义状态逻辑

这是聊天机器人所处状态的逻辑。如果最后一条消息是工具调用,那么我们处于“提示创建者”(prompt)应该响应的状态。否则,如果最后一条消息不是HumanMessage,那么我们知道人类应该下一条响应,所以我们处于END状态。如果最后一条消息是HumanMessage,那么如果之前有工具调用,我们处于提示状态。否则,我们处于“信息收集”(info)状态。

from typing import Literal

from langgraph.graph import END

# 定义一个函数,用于获取当前状态

def get_state(state)-> Literal["add_tool_message","info","__end__"]:

messages = state["messages"]

if isinstance(messages[-1],AIMessage) and messages[-1].tool_calls:

return "add_tool_message"

elif not isinstance(messages[-1], HumanMessage):

return END

return "info"

创建图形

我们现在可以创建图形。我们将使用SqliteSaver来保存对话历史记录。

# Create the graph

from langgraph.checkpoint.memory import MemorySaver

from langgraph.graph import StateGraph,START

from langgraph.graph.message import add_messages

from typing import Annotated

from typing_extensions import TypedDict

class State(TypedDict):

messages: Annotated[list, add_messages]

memory = MemorySaver()

workflow = StateGraph(State)

workflow.add_node("info",info_chain)

workflow.add_node("prompt",prompt_gen_chain)

# 工具调用用来做提示词生成

@workflow.add_node

def add_tool_message(state:State):

return {

"messages":[

ToolMessage(

content="Prompt generated!",

tool_call_id= state["messages"][-1].tool_calls[0]['id']

)

]

}

workflow.add_edge(START,"info")

workflow.add_conditional_edges("info",get_state)

workflow.add_edge("add_tool_message","prompt")

workflow.add_edge("prompt",END)

graph = workflow.compile(checkpointer=memory)

打印图

执行图

import uuid

config = {"configurable":{"thread_id":str(uuid.uuid4())}}

while True:

user = input("User (q/Q to quit): ")

print(f"User (q/Q to quit): {user}")

if user in {"q", "Q"}:

print("AI: Byebye")

break

output = None

for output in graph.stream(

{"messages":[HumanMessage(content=user)]}, config=config, stream_mode="updates"

):

last_message = next(iter(output.values()))["messages"][-1]

last_message.pretty_print()

if output and "prompt" in output:

print("Done!")

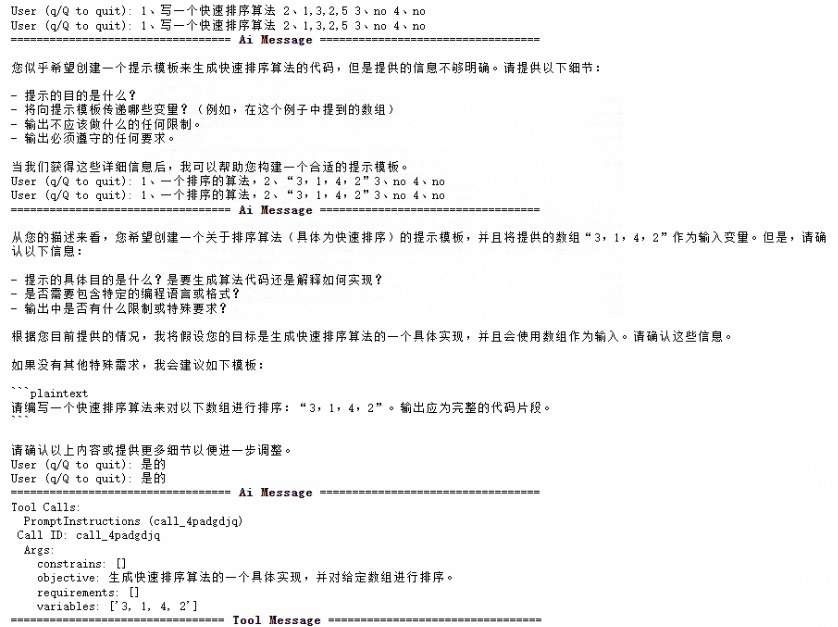

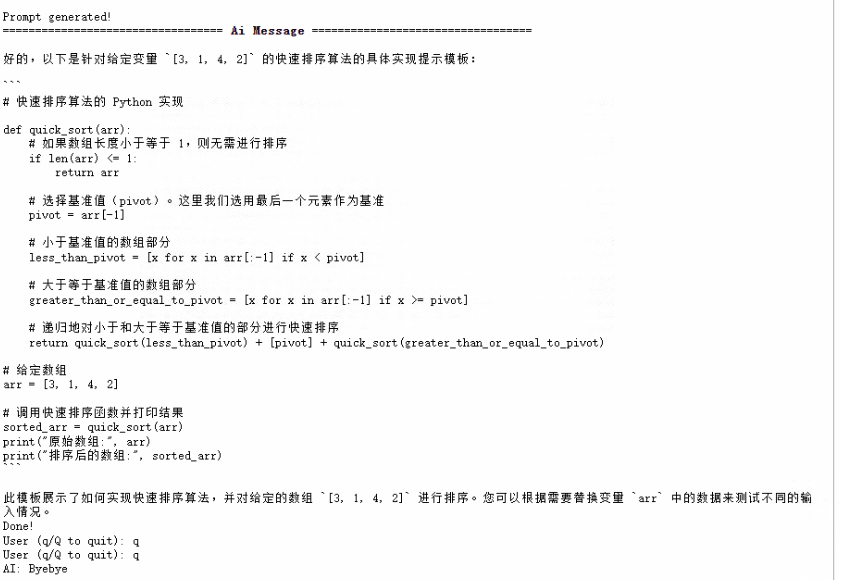

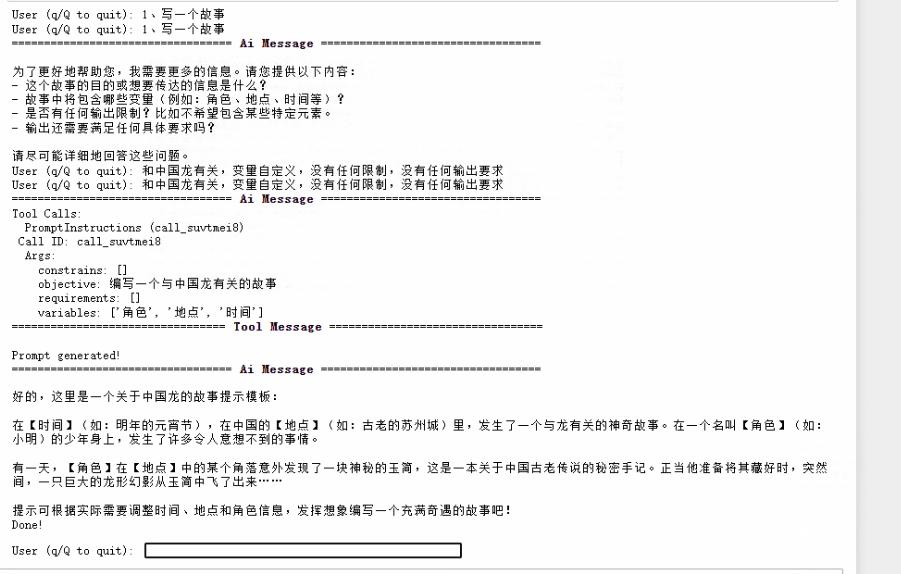

**测试效果**

使用程序,需要输入4个条件

- 提示的目的是什么?

- 将向提示模板传递哪些变量?(例如,在这个例子中提到的数组)

- 输出不应该做什么的任何限制。

- 输出必须遵守的任何要求。

首先测试一个 排序算法

1、写一个快速排序算法 2、“1,3,2,5“ 3、no 4、no

测试一个 ,写故事的

当你输入不完整时,他会自动要求你继续输入,还是很不错的,

哈哈试试吧

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

学习路线

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)